Se você é daquelas pessoas que têm medo de ver a inteligência artificial (IA) começar a se rebelar contra nós, seres humanos, acaba de ganhar mais um argumento a seu favor: cientistas do Instituto de Tecnologia de Massachussets (MIT), uma das universidades mais renomadas do mundo, acabam de criar uma IA psicopata.

Mas calma, os cientistas não fizeram isso com más intenções. O objetivo do estudo era ver como que os dados apresentados podem influenciar o desempenho de algoritmos. Assim, alimentaram uma inteligência artificial, que era capaz de analisar e compreender fotografias, com imagens assustadoras e bizarras espalhadas pela internet, incluindo morte de pessoas, que aconteceram das mais diversas formas. Muitas delas foram retiradas do fórum Reddit.

Os cientistas do MIT acabaram dando a essa inteligência artificial o nome de Norman, inspirado no personagem Norman Bates, do clássico filme Psicose, de Alfred Hitchcock.

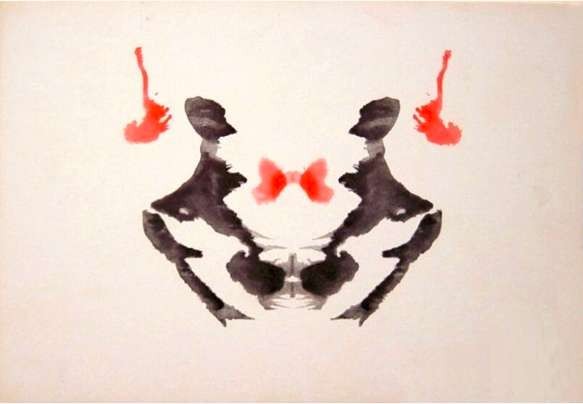

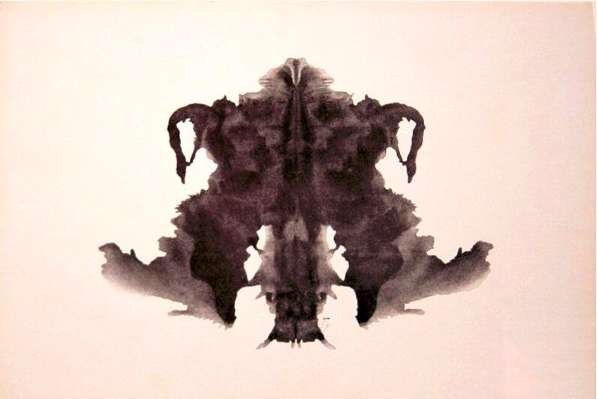

Logo após se submeter a essa experiência, Norman teve passar pelo conhecido Teste de Rorschach, aqueles borrões de tinta em que as pessoas precisam descrever o que estão vendo. Ao mesmo tempo, outra inteligência artificial passou pelo mesmo procedimento, mas após ser submetido a imagens mais amigáveis, como pássaros, gatos e pessoas.

E como você já deve imaginar, os resultados chamaram bastante a atenção. Vamos começar pela imagem abaixo.

A inteligência artificial “normal” apenas disse ter visto duas pessoas, uma de frente para a outra. Já Norman afirmou a imagem se tratava de um homem saltando por uma janela.

Já neste outro borrão, IA “normal” alegou ter visto uma luva de beisebol em preto e branco. Já Norman disse ter reconhecido um homem sendo morto a tiros na luz do dia.

Se quiser, pode conferir as demais respostas dadas pela inteligência artificial em sua site criado pelo MIT para apresentar Norman. Clique aqui para acessar (atenção: está em inglês).

Com os resultados em mãos, os pesquisadores responsáveis pelo experimento afirmam que dados apresentados a uma IA são até mais importantes que seus algoritmos e mostra os perigos de utilizar uma inteligência artificial para fins maléficos.

“Norman sofreu de uma extensa exposição aos cantos mais escuras do Reddit, e ele representa um estudo de caso sobre os perigos de a inteligência artificial que dá errado quando dados tendenciosos são utilizados em algoritmos de aprendizado de máquina”, explicaram os responsáveis pelo estudo.